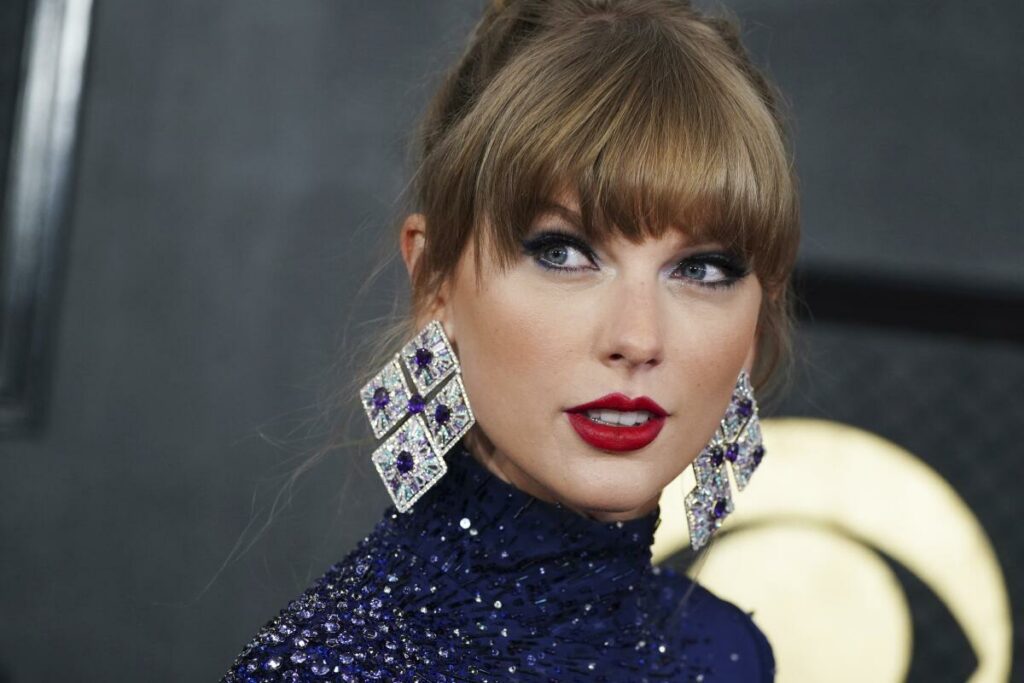

Instagram, X y Threads refuerzan medidas contra imágenes manipuladas de la cantante.

Madrid, 29 Ene. – Las redes sociales, incluyendo Instagram y Threads, han tomado medidas drásticas bloqueando las búsquedas relacionadas con Taylor Swift, en respuesta a la difusión masiva de imágenes manipuladas de la cantante. Estas imágenes, creadas con tecnologías avanzadas de inteligencia artificial (IA), muestran a Swift en situaciones comprometedoras y han causado gran controversia.

Las imágenes, calificadas como 'deepfakes', fueron distribuidas inicialmente en la red social X y en un foro de Telegram, donde usuarios emplearon herramientas como Microsoft Designer para crear representaciones falsas de mujeres desnudas, incluyendo a Swift, sin su consentimiento. Según informes de 404 Media, estas imágenes alcanzaron una circulación masiva.

X y otras plataformas similares, incluyendo Meta y sus redes sociales Threads e Instagram, han comenzado a eliminar activamente estas imágenes y a tomar medidas contra las cuentas responsables. Una publicación llegó a tener 45 millones de visualizaciones y miles de interacciones antes de ser retirada, según The Verge.

Las búsquedas utilizando palabras clave relacionadas con estas imágenes, como "Taylor Swift AI", ahora resultan en notificaciones de error, aunque el bloqueo no es completamente efectivo.

Este incidente destaca un problema más amplio relacionado con el 'deepfake', que afecta principalmente a las mujeres. Un estudio de Home Security Heroes en 2023 encontró que el 77% del contenido de deepfake en plataformas como YouTube, Vimeo y Dailymotion está protagonizado por mujeres, aumentando al 99% en el caso de los deepfakes pornográficos. Las figuras públicas, especialmente cantantes y actrices, son las más afectadas por este tipo de manipulación.

La tecnología de deepfake, que comenzó a evolucionar en 2014 con el desarrollo de redes generativas antagónicas (GAN), ha avanzado significativamente, permitiendo la creación de imágenes y videos altamente realistas. Esto plantea serias preocupaciones sobre la veracidad de los contenidos en línea y el potencial daño a la reputación de las personas representadas sin su consentimiento.

El caso de Swift no es aislado; en 2017, se difundieron vídeos pornográficos falsos de celebridades, y recientemente se descubrieron falsos desnudos de menores en Almendralejo, Extremadura. Estos incidentes resaltan la necesidad urgente de medidas más efectivas para proteger la privacidad y la imagen pública en la era digital.

Al margen:

Los deepfakes son archivos de imagen, vídeo o voz manipulados para que parezcan reales. También se les conoce como "medios sintéticos". Los deepfakes se crean utilizando programas de inteligencia artificial o algoritmos como el GAN. Los deepfakes son tan convincentes que pueden engañar tanto a las personas como a los algoritmos.